ローカルAI– category –

-

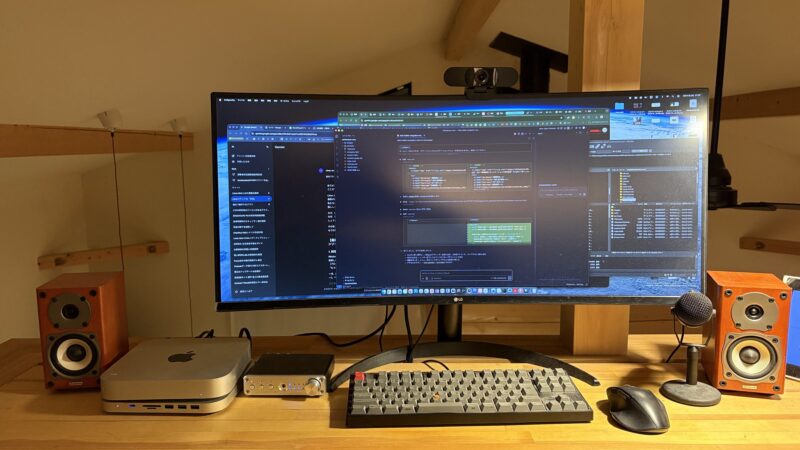

Mac Mini(M1〜M4)が”AIの家”として(今のところ)最も優れた場所と評価される理由

スマートフォンやブラウザから呼び出すだけでなく、自分の部屋の片隅に常時稼働するマシンを置き、そこにAIエージェントを常駐させる、そういう使い方が、静かに広がりつつあります。 スケジュールのチェック、メールの下書き、ニュースの要約、コードのレビュー、ファイルの整理。自分が寝ている間も、会議に出ている間も、AIが裏で粛々とタ... -

LinuxMintでローカルAI(2)端末でOllama、ブラウザーでOpen WebUIをPython上で動作

ローカル環境で大規模言語モデル(LLM)を簡単に実行・管理できるツールとして、前回はLM Studioをご紹介しました。今回は、オープンソースのツールである「Ollama」を用いて端末上でローカルAIを利用する方法、さらにはブラウザーでも利用できるようにOpen WebUIをPython上で動作させる手順についてご紹介させていただきます。 Ollamaのイン... -

LinuxMintでローカルAI(1)LM Studioで簡単動作。メモリー16GBのパソコン上でAIを動かす

「AIを使ってみたいけど、データをクラウドに上げるのは不安…」「インターネットがない場所でも使いたい」。そんな悩みを解決するのが、自分のPC上でAIを動かす「ローカルAI」です。 この記事では、安定性と使いやすさで定評のあるLinux Mintで稼働するPCに、人気のローカルAI実行ツール「LM Studio」を導入し、手軽にAIと対話する方法を解説...

1